De nieuwe EU-code voor algemene AI: wat betekent dit voor ontwikkelaars?

De nieuwe EU-code voor algemene AI: wat betekent dit voor ontwikkelaars?

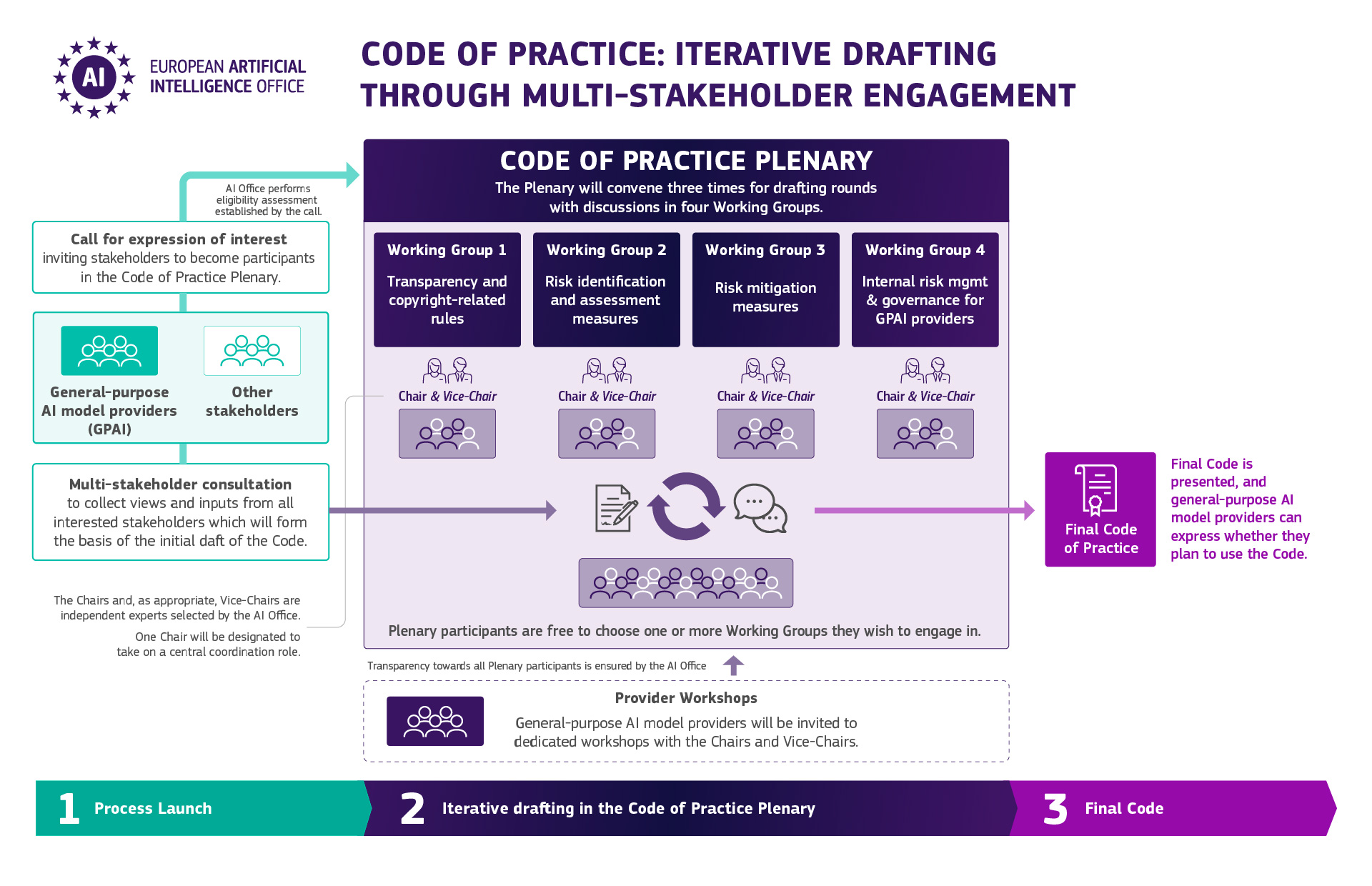

De Europese Unie heeft op 10 juli 2025 de General-Purpose AI Code of Practice gepubliceerd. Dit document, dat oorspronkelijk gepland stond voor mei, biedt AI-ontwikkelaars een leidraad om te voldoen aan de EU AI Act en boetes te vermijden. In een tijd waarin kunstmatige intelligentie razendsnel evolueert, is deze code een cruciale stap naar verantwoorde innovatie. Laten we duiken in wat dit betekent voor de sector.

Wat is de General-Purpose AI Code of Practice?

De code is een vrijwillig raamwerk dat AI-bedrijven helpt om compliance met de AI Act aan te tonen. Het is geen bindende wet, maar biedt een praktische handleiding voor ontwikkelaars van algemene AI-modellen, zoals ChatGPT, Llama en Gemini. OpenAI heeft zich al gecommitteerd aan de code, wat aangeeft dat grote spelers het serieus nemen. De code is opgesteld door een werkgroep van experts en richt zich op de kernverplichtingen van de AI Act, die op 2 augustus 2025 van kracht worden voor algemene AI-systemen.

Het document is verdeeld in drie hoofdstukken: transparantie, auteursrecht en veiligheid & beveiliging. Het derde hoofdstuk geldt specifiek voor modellen met systemische risico's, die extra strenge eisen krijgen. Door deel te nemen aan deze code kunnen bedrijven aantonen dat ze proactief omgaan met risico's, wat hen kan beschermen tegen hoge boetes – tot wel 7% van de wereldwijde omzet.

Belangrijkste hoofdstukken en verplichtingen

Transparantie: Dit hoofdstuk benadrukt het belang van openheid over hoe AI-modellen werken. Ontwikkelaars moeten gedetailleerde informatie verstrekken over trainingsdata, modelarchitectuur en gebruikte algoritmes. Dit helpt gebruikers en toezichthouders om de betrouwbaarheid van AI-systemen te beoordelen. Voor algemene AI is transparantie cruciaal om misinformatie en bias te voorkomen.

Auteursrecht: Een heet hangijzer in de AI-wereld. De code geeft richtlijnen over hoe om te gaan met auteursrechtelijk beschermd materiaal in trainingsdata. Bedrijven moeten mechanismen implementeren om inbreuken te detecteren en te vermijden. Dit is een reactie op rechtszaken zoals die van auteurs en kunstenaars tegen AI-bedrijven, en helpt om een evenwicht te vinden tussen innovatie en intellectueel eigendom.

Veiligheid & beveiliging: Voor geavanceerde modellen met systemische risico's zijn er extra eisen. Dit omvat risicobeoordelingen, mitigerende maatregelen en rapportageverplichtingen. De code moedigt aan tot het uitvoeren van red teaming – gesimuleerde aanvallen om kwetsbaarheden te testen – en het delen van veiligheidsrapporten met de EU-commissie.

Deze hoofdstukken zijn niet alleen theoretisch; ze bevatten praktische templates en checklists die ontwikkelaars direct kunnen toepassen.

De tijdlijn van de EU AI Act

De AI Act zelf is een mijlpaal in regelgeving. Hier is een overzicht van de implementatiefases:

- 2 februari 2025: Verbod op AI-systemen met onaanvaardbaar risico, zoals sociale scoring.

- 2 augustus 2025: Vereisten voor algemene AI-modellen treden in werking, inclusief de code.

- 2 augustus 2026: Regels voor high-risk AI-systemen worden afdwingbaar.

- December 2030: Volledige compliance voor alle AI-systemen.

Deze gefaseerde aanpak geeft bedrijven tijd om zich aan te passen, maar de deadline voor algemene AI nadert snel. De code fungeert als een brug naar compliance, met een definitieve versie die nu beschikbaar is na input van stakeholders.

Implicaties voor AI-ontwikkelaars

Voor ontwikkelaars betekent dit een verschuiving naar meer verantwoorde praktijken. Bedrijven als OpenAI, Meta en Google moeten hun modellen aanpassen om aan de eisen te voldoen. De vrijwillige aard van de code maakt het aantrekkelijk: door eraan deel te nemen, toon je goodwill en vermijd je potentieel strengere audits.

In Nederland, waar 22,7% van de bedrijven met meer dan 10 werknemers AI gebruikt, kan dit leiden tot een leidende rol in Europa. Echter, de helft van de organisaties heeft nog geen AI-strategie, wat urgentie benadrukt. De code biedt een kans om voorop te lopen in ethische AI-ontwikkeling.

Uitdagingen en kansen

Natuurlijk zijn er uitdagingen. Kleine startups zouden de administratieve last zwaar kunnen vinden, terwijl grote techbedrijven hun lobbykracht gebruiken om de regels te beïnvloeden. Toch biedt de code kansen voor innovatie: door focus op veiligheid en transparantie kan AI betrouwbaarder worden, wat leidt tot bredere adoptie.

Experts waarschuwen dat non-compliance dure gevolgen kan hebben. Met de AI Act als 's werelds eerste uitgebreide AI-wet, zet de EU de toon voor globale standaarden. Ontwikkelaars die nu investeren in compliance, positioneren zichzelf voor succes in een gereguleerde toekomst.

Samenvattend is de General-Purpose AI Code of Practice een welkome gids in een complex landschap. Het balanceert innovatie met verantwoordelijkheid, en helpt de EU om een veilige, ethische AI-toekomst te bouwen. Voor ontwikkelaars is het tijd om actie te ondernemen – de klok tikt.

Brainvine Teams

Zakelijk de beste oplossing

Met Brainvine Teams til je de samenwerking binnen je team naar een hoger niveau. Ons platform biedt een solide user-management systeem.

Daarnaast kun je Style Tones, Wolleys en Workflows onderling delen en bewerken, zodat iedereen dezelfde lijn volgt. Dit betekent dat alle communicatie uit jouw team consistent en professioneel is, ongeacht wie het woord voert. Wel zo handig!

Meteen aan de slag, of eerst een demo?

Bekijk onze uitgelichte artikelen

Laat je inspireren door onze uitgelichte artikelen.